Kürzlich wurde bekannt, dass Apple-Forscher eine neue Methode zum Trainieren von KI-Modellen entwickelt haben, die Bildbeschreibungen generieren. Die neuen Modelle liefern präzisere und detailliertere Beschreibungen und sind deutlich kleiner als vergleichbare Modelle.

In einer neuen Studie mit dem Titel „RubiCap: Rubrikbasiertes Reinforcement Learning für die Generierung detaillierter Bildbeschreibungen“ entwickelte Apples Forschungsteam in Zusammenarbeit mit der University of Wisconsin-Madison ein neues Framework zur Generierung detaillierter Bildbeschreibungen und erzielte damit führende Ergebnisse in mehreren Benchmarks. Ziel der Generierung detaillierter Bildbeschreibungen ist es, detaillierte Beschreibungen für jedes Element und jeden Bereich eines Bildes zu erstellen, anstatt nur eine allgemeine Übersicht. Dies ermöglicht ein tieferes Verständnis von Bildszenen und kann zum Trainieren von Modellen für visuelle Sprache und Text-zu-Bild-Umwandlung genutzt werden, wodurch die Bildsuche und andere Assistenzsysteme verbessert werden.

Forscher weisen darauf hin, dass die aktuellen KI-Methoden zum Trainieren von Modellen zur Generierung dichter Bildbeschreibungen erhebliche Schwächen aufweisen. Die Kennzeichnung hochwertiger Daten auf Expertenniveau ist kostspielig. Leistungsstarke visuelle Sprachmodelle können zwar synthetische Beschreibungen generieren, doch die überwachte Destillation führt zu einer begrenzten Ergebnisvielfalt und schwachen Generalisierungsfähigkeit. Obwohl Reinforcement Learning diese Einschränkungen überwinden kann, ist es schwierig, es auf die Generierung offener Beschreibungen anzuwenden.

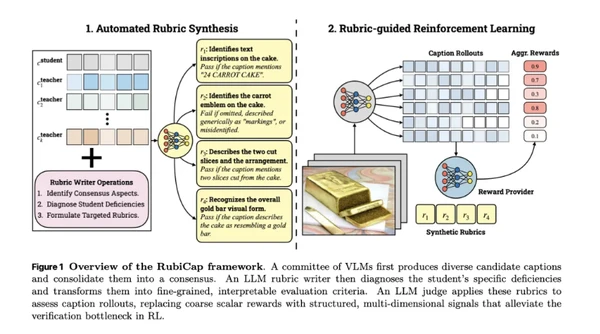

Um diesem Problem zu begegnen, entwickelte das Forschungsteam ein neues Framework. Sie wählten zufällig 50.000 Bilder aus zwei Trainingsdatensätzen, PixMoCap und DenseFusion-4V-100K, aus und nutzten etablierte visuelle Sprachmodelle wie Gemini 2.5 Pro und GPT-5, um für jedes Bild mehrere Beschreibungsoptionen zu generieren. Parallel dazu erstellte das Modell im RubiCap-Framework eine eigene Beschreibung. Anschließend analysierte RubiCap mithilfe von Gemini 2.5 Pro die Bilder, die Beschreibungsvorschläge und die Ergebnisse des Modells, um die Bewertungskriterien festzulegen. Abschließend bewertete Qwen2.5-7B-Instruct die Bilder anhand dieser Kriterien und generierte so ein Belohnungssignal für das Training.

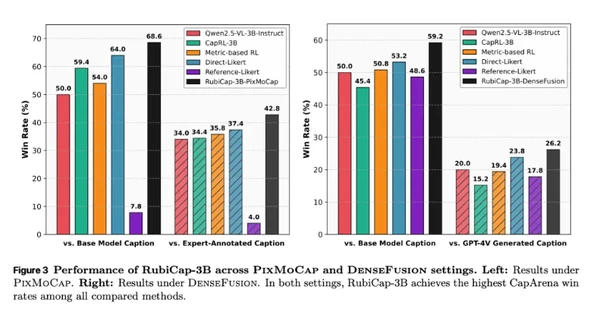

Letztendlich entwickelte das Forschungsteam drei Modelle: RubiCap-2B, RubiCap-3B und RubiCap-7B mit 2 Milliarden, 3 Milliarden bzw. 7 Milliarden Parametern. Im Vergleich zu bestehenden Methoden schnitten sie außergewöhnlich gut ab und übertrafen sogar Modelle mit bis zu 72 Milliarden Parametern. In einer Blindbewertung belegte RubiCap-7B den ersten Platz unter allen Modellen und wies die geringste Halluzinationsstrafe sowie die höchste Genauigkeit auf. Die Studie zeigt außerdem, dass das kleine Modell mit 3 Milliarden Parametern größere Modelle in bestimmten Benchmarks übertrifft. Dies impliziert, dass hochwertige, dichte Modelle zur Generierung von Bildbeschreibungen nicht zwangsläufig eine enorme Größe benötigen.