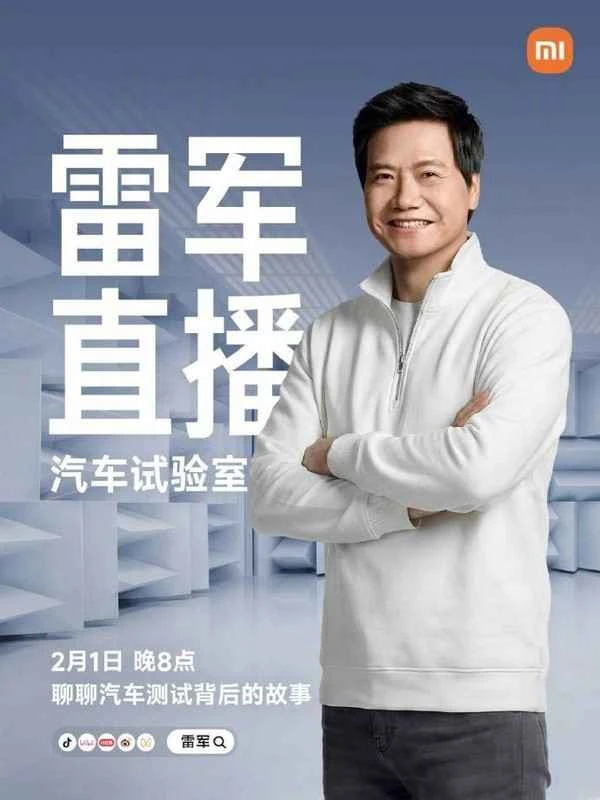

Am 27. März fand in Shenzhen der CFMS|MemoryS 2026 Summit unter dem Motto „Zyklen meistern, Wertschöpfung freisetzen“ statt. Der Gipfel brachte führende Unternehmen der globalen Wertschöpfungskette aus den Bereichen Speicher, CPU/GPU, KI-Big-Data-Modelle und Automobil zusammen, um zu erörtern, wie Speicherhersteller, Anbieter von Anwendungssoftware und Plattformanbieter neue Technologien und Produkte integrieren können, um gemeinsam ein effizientes Ökosystem im Zeitalter der KI zu schaffen. Wan Weixing, Leiter der KI-Produkttechnologie bei Qualcomm China, war als Teilnehmer eingeladen und hielt eine Keynote-Rede, in der er erörterte, wie Edge Computing die Entwicklung der Zukunft persönlicher KI im Zuge der KI-Innovationen für intelligente Agenten vorantreiben wird.

Wan Weixing betonte, dass die Entwicklung persönlicher KI am Netzwerkrand ihren Anfang nimmt. Wir bewegen uns hin zu einem nutzerzentrierten Multi-Terminal-Erlebnis. Intelligente Agenten am Netzwerkrand ermöglichen geringere Latenzzeiten, bessere Personalisierung und ein nahtloses Nutzererlebnis. Qualcomm bietet mit einer einheitlichen Technologie-Roadmap eine leistungsstarke und energieeffiziente Hardware- und Software-Basis für eine breite Produktpalette und stellt plattformübergreifende Funktionen für verschiedene Endgeräte und Anwendungsszenarien bereit, um persönliche KI zu ermöglichen.

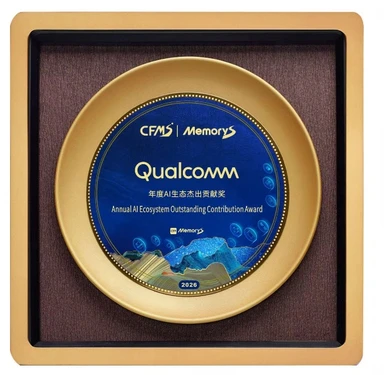

Um herausragende Unternehmen und Führungskräfte der Wertschöpfungskette zu würdigen und Branchenstandards zu setzen, wurden im Rahmen des Gipfels auch die MemoryS Awards verliehen. Qualcomm erhielt den „Outstanding Contribution to the AI Ecosystem Award“ für seine führende Rolle beim Aufbau eines „Edge-Intelligence-Ökosystems“. Das Unternehmen erweiterte sein Geschäft von Smartphones auf ein breites Spektrum an Edge-Bereichen wie Personal AI und Smart Wearables, PCs, Automobile, Edge-Netzwerke und das industrielle IoT und förderte die Lokalisierung von KI, um geringe Latenz und hohe Sicherheit im Internet der Dinge zu erreichen.

Nachfolgend der vollständige Text der Rede von Wan Weixing:

Guten Morgen, verehrte Gäste und Freunde. Mein heutiges Thema lautet: „Führende KI-Innovationen für intelligente Agenten: Die Zukunft der persönlichen KI am Netzwerkrand gestalten“. Betrachten wir zunächst die Entwicklungsstufen von KI in industriellen Anwendungen. Die erste Stufe lässt sich als perzeptuelle KI bezeichnen. Perzeptuelle KI ist nicht unbekannt; sie umfasst das Verstehen von Multimediasignalen wie Sprachsignalen, die Klassifizierung und Erkennung von Bildern sowie die Anwendung traditioneller Bereiche wie der intelligenten Rauschunterdrückung. Diese Art von perzeptueller KI ist bereits auf den meisten Edge-Plattformen kommerziell verfügbar. Ein typisches Beispiel ist die computergestützte Fotografie im Mobiltelefonbereich, die von der Implementierung perzeptueller KI profitiert.

Die zweite Stufe ist die generative KI. Diese Stufe zeichnet sich dadurch aus, dass KI unter überwachten Bedingungen spezifische Probleme lösen kann, basierend auf umfangreichem Vortraining mit großen Datenmengen. Beispiele hierfür sind das ChatGPT-Modell von OpenAI und Text-zu-Bild-Modelle. Die dritte Stufe ist die Agenten-KI. Ein wesentlicher Unterschied zwischen Agenten-KI und generativer KI besteht darin, dass Agenten-KI die Nutzerabsicht selbstständig verstehen, Aktionen ausführen und Entscheidungen in einer unüberwachten Umgebung treffen kann. Dadurch hilft sie uns, etwas komplexere Aufgaben zu lösen. Die vierte Stufe ist die physikalische KI. Diese Stufe ermöglicht es der KI, die physikalische Welt wirklich zu verstehen und Feedback und Ausgaben auf Basis der physikalischen Gesetze der realen Welt zu liefern. Diese Technologie befindet sich noch in der frühen Anwendungsphase. Wer den Mobile World Congress (MWC) in Barcelona dieses Jahr verfolgt hat, konnte die großen Fortschritte der Branche bei der Erforschung physikalischer KI mitverfolgen.

Aktuell konzentriert sich die Branche vor allem auf die zweite und dritte Phase. Betrachten wir nun die Entwicklungstrends der generativen KI. Ein entscheidender Punkt ist die rasante Verbesserung der Intelligenz von generativen KI-Modellen auf Edge-Geräten. Zum einen steigt die Anzahl der von Edge-Geräten unterstützten Modellparameter dramatisch an. So lassen sich beispielsweise auf Mobiltelefonen bereits große Modelle mit 1 bis 10 Milliarden Parametern ausführen, auf PCs sogar mit 13 bis 20 Milliarden. In Fahrzeugen könnte die Anzahl der unterstützten Modellparameter sogar noch höher liegen und 20 bis 60 Milliarden erreichen.

Auf kleineren Geräten wie AR-Brillen und stromsparenden Geräten ermöglichen wir die vollständige Ausführung von Modellen mit 1 bis 4 Milliarden Parametern direkt am Netzwerkrand. Obwohl die Anzahl der Parameter in Edge-Modellen im Vergleich zu großen Cloud-Modellen noch relativ gering ist, treiben verschiedene Technologien in der Branche das Wachstum großer Edge-Modelle voran. Beispielsweise können eine erhöhte Speicherbandbreite und die Optimierung der Quantisierungsbitbreite die Modellgröße weiter reduzieren, wodurch Endgeräte komplexere Modelle unterstützen können.

Hinsichtlich der Leistungsfähigkeit des Modells konnten wir zwei Punkte feststellen. Erstens haben wir im letzten Jahr erfolgreich große Modelle mit Inferenzfunktionen auf Edge-Geräten implementiert. Zweitens steigt die unterstützte Kontextlänge für diese großen Edge-Modelle in verschiedenen Szenarien. Vor etwa drei Jahren lag die Kontextlänge für Edge-Geräte im Allgemeinen bei 1k–2k; vor zwei Jahren wurde sie für die meisten Szenarien auf 2k–4k erweitert; und im letzten Jahr hat Qualcomm diesen Bereich durch die Untersuchung von Szenarien mit Partnern auf 4k–8k erhöht. In einigen spezifischen Szenarien können wir sogar Kontextlängen von 32k–128k unterstützen.

Die Implementierung längerer Kontexte auf dem Gerät stellt eine Herausforderung dar. Mit zunehmender Kontextlänge steigt der Bedarf an Key-Value-Caches. Dies führt direkt zu einem erhöhten Speicherbedarf und einer höheren Speicherbandbreite, wenn das gesamte Modell auf dem Gerät implementiert wird. Im Hinblick auf die modale Weiterentwicklung beobachten wir zudem, dass sich Gerätemodelle von einfachen Text-zu-Text-, Text-zu-Bild- und Bild-zu-Bild-Eingaben hin zu komplexeren multimodalen Ansätzen entwickeln. Diese umfassen Sprach-, Text-, Foto-, Bild- und Sensoreingaben und streben sogar eine vollständige Modalitätsintegration an. Auf dem Snapdragon Summit im vergangenen September demonstrierte Qualcomm die Zusammenarbeit mit Partnern, um ein vollständig modales Modell mit 5 Milliarden Parametern auf dem Gerät auszuführen und Nutzern so die Interaktion in natürlicher Sprache zu ermöglichen.

Nachdem wir die Trends vorgestellt haben, möchte ich nun die Vorteile und Herausforderungen des Einsatzes von generativer KI auf Edge-Geräten beleuchten. Der größte Vorteil liegt meiner Meinung nach in der Personalisierung. Da sich alle Daten eines Nutzers am Edge befinden und auch die Quelle neuer Daten dort liegt, ist die direkte Inferenz an der Datenquelle ein natürlicher Prozess und schützt zudem die Privatsphäre der Nutzer besser. Darüber hinaus bietet Edge-KI einen Kostenvorteil und benötigt keine Netzwerkverbindung, sodass Nutzer die Dienste jederzeit und überall nutzen können. Bezüglich der Herausforderungen möchte ich einige Punkte hervorheben. Erstens ist der Speicher von Edge-Geräten begrenzt. Obwohl es viele technische Möglichkeiten zur Komprimierung der Modellgröße gibt, setzt der begrenzte Speicher letztendlich eine Obergrenze für die Größe ausführbarer Modelle und damit auch für die Leistungsfähigkeit von Edge-KI.

Zweitens ist auch die Speicherbandbreite auf dem Gerät begrenzt. Wie wir alle wissen, ist die begrenzte Speicherbandbreite ein wesentliches Merkmal autoregressiver Netzwerke. Die begrenzte Bandbreite beeinträchtigt die Geschwindigkeit, mit der große Modelle Token ausgeben, und wirkt sich somit in bestimmten Szenarien auf die Benutzerfreundlichkeit aus. Drittens möchte ich betonen, dass Energieeffizienz bei vielen Endgeräten, insbesondere bei hochintegrierten Geräten wie Mobiltelefonen, von entscheidender Bedeutung ist. Wir müssen vermeiden, dass die Temperaturregelung während der KI-Inferenz die Grenzwerte überschreitet, um eine Überhitzung des Geräts zu verhindern. Daher ist die Optimierung des Verhältnisses von Speichergröße, Bandbreite, Leistung und Energieeffizienz ein Problem, an dessen Lösung wir und unsere Industriepartner arbeiten.

Betrachten wir nun die Trends im Bereich intelligenter Agenten-KI. Im Mittelpunkt steht dabei die Frage, wie eine optimale Anpassung zwischen geräteinternen intelligenten Agenten und Nutzern erreicht werden kann. Der erste wichtige Trend sind geräteinterne intelligente Agenten, deren Kern in geringerer Latenz, besserer Personalisierung und einem durchgängig nahtlosen Nutzererlebnis liegt. Der zweite Trend ist die Spezialisierung von Agenten. Anfänglich wünschte man sich ein einheitliches Modell zur Lösung der meisten Probleme; heute bewegen wir uns hin zur Aufgabenspezialisierung und lösen Probleme mithilfe spezialisierter intelligenter Agenten und Multiagenten-Frameworks. Der dritte Trend, der meiner Meinung nach für das Nutzererlebnis am wichtigsten ist, ist die hohe Personalisierung. Geräteinterne intelligente Agenten sind nicht mehr die einfachen Sprachassistenten von früher, sondern haben sich zu wirklich verstehenden KI-Assistenten entwickelt, die Nutzerabsicht, Kontext und Wahrnehmung vollständig erfassen können.

Betrachten wir die grundlegenden Module intelligenter Agenten-KI genauer. Man kann sich einen intelligenten Agenten als ein kontinuierlich laufendes, geschlossenes System vorstellen. Dieses System umfasst mehrere Basismodule, wie beispielsweise Module für Wahrnehmung, Verständnis und Schlussfolgerung sowie Speicher-, Werkzeug- und Ausführungssysteme. Diese Module arbeiten zusammen, damit der intelligente Agent die Absicht des Nutzers versteht, dessen Eingaben verarbeitet, die Informationen in mehrere Aufgaben aufteilt und das Ziel selbstständig erreicht. Noch wichtiger ist, dass der intelligente Agent am Netzwerkrand ein Nutzererlebnis bietet, das kontinuierlich wahrnimmt, denkt und handelt.

KI-Agenten verändern grundlegend die Interaktionsmuster in der neuen digitalen Welt. Qualcomm betont seit zwei Jahren: „KI ist die neue Benutzeroberfläche.“ Künftig interagieren Nutzer nicht mehr mit einzelnen Apps oder Funktionen, sondern ganz natürlich per Sprach- oder Texteingabe mit intelligenten Agenten. Diese Agenten verstehen die Nutzereingaben, zerlegen Aufgaben und planen sie. In Kombination mit großflächigen On-Device-Modellen auf der Snapdragon-Plattform lassen sich so viele Aufgaben lösen. Durch universelle Modelle in der Cloud ermöglicht KI ein breites Anwendungsspektrum, darunter Unterhaltung, Produktivitätstools und Industrieanwendungen.

In der Vergangenheit konzentrierte sich persönliche KI hauptsächlich auf Smartphones, wobei Kopfhörer, Brillen und Smartwatches als Zubehör dienten. Künftig bewegen wir uns hin zu einem geräteübergreifenden Erlebnis, das KI und Nutzer in den Mittelpunkt stellt. Das bedeutet, dass KI nicht mehr an ein bestimmtes Gerät gebunden sein wird. Stattdessen wird sie die Absicht des Nutzers verstehen und Aufgaben durch flexible Zusammenarbeit mehrerer Geräte ausführen. KI-Geräte werden lediglich die Träger der KI sein; die Zukunft persönlicher KI-Erlebnisse wird sich zweifellos hin zu einem kontinuierlicheren und nahtloseren Nutzererlebnis entwickeln. Aus unserer Sicht muss persönliche KI auf Geräteebene ansetzen, da diese dem Nutzer am nächsten ist, alle seine Informationen besitzt und somit seine individuellen Absichten, den Kontext und die Präferenzen unmittelbar erfassen kann.

Persönliche KI funktioniert jedoch nicht isoliert; sie kann über eine hybride KI-Architektur geräteübergreifend, lokal, netzwerkweit und in der zentralen Cloud zusammenarbeiten. Qualcomm hat letztes Jahr mehrere Produkte auf den Markt gebracht, die ausreichend Rechenleistung für persönliche KI-Szenarien bieten, darunter die mobile Plattform Snapdragon 8 Ultra der fünften Generation und die Computerplattform Snapdragon X2 Elite. Viele kommerzielle Geräte mit diesen Snapdragon-Plattformen sind bereits erhältlich.

Wir haben soeben die Endgeräteseite besprochen. Im Bereich der Rechenzentren haben wir auf dem diesjährigen MWC außerdem Beschleunigerkarten und Racksysteme auf Basis der Qualcomm AI200- und AI250-Chips vorgestellt. Wir bieten Rack-Performance und überragende Speicherkapazität für generative KI-Inferenz in Hochgeschwindigkeits-Rechenzentren bei branchenführenden Gesamtbetriebskosten (TCO). Insbesondere der AI250 zeichnet sich durch eine innovative Speicherarchitektur aus, die einen revolutionären Effizienzsprung bei KI-Verarbeitungs-Workloads ermöglicht.

Abschließend möchte ich Qualcomms KI-Strategie zusammenfassen. Von Unterhaltungselektronik wie Smartphones, Kopfhörern, Wearables und PCs bis hin zu Automobilen, Robotern und sogar Rechenzentren der nächsten Generation statten wir alle unsere Produkte mit einer einheitlichen KI-Architektur aus. Kern dieser Strategie ist unsere Fähigkeit, durch eine einheitliche technische Roadmap eine leistungsstarke und energieeffiziente Hardware- und Softwaregrundlage zu schaffen. Dadurch können Qualcomms KI-Fähigkeiten von einzelnen Produkten oder Chips auf umfassende, geräte- und szenarioübergreifende Plattformfunktionen ausgeweitet werden.

Damit ist meine heutige Präsentation beendet. Vielen Dank an alle.